测试与调试

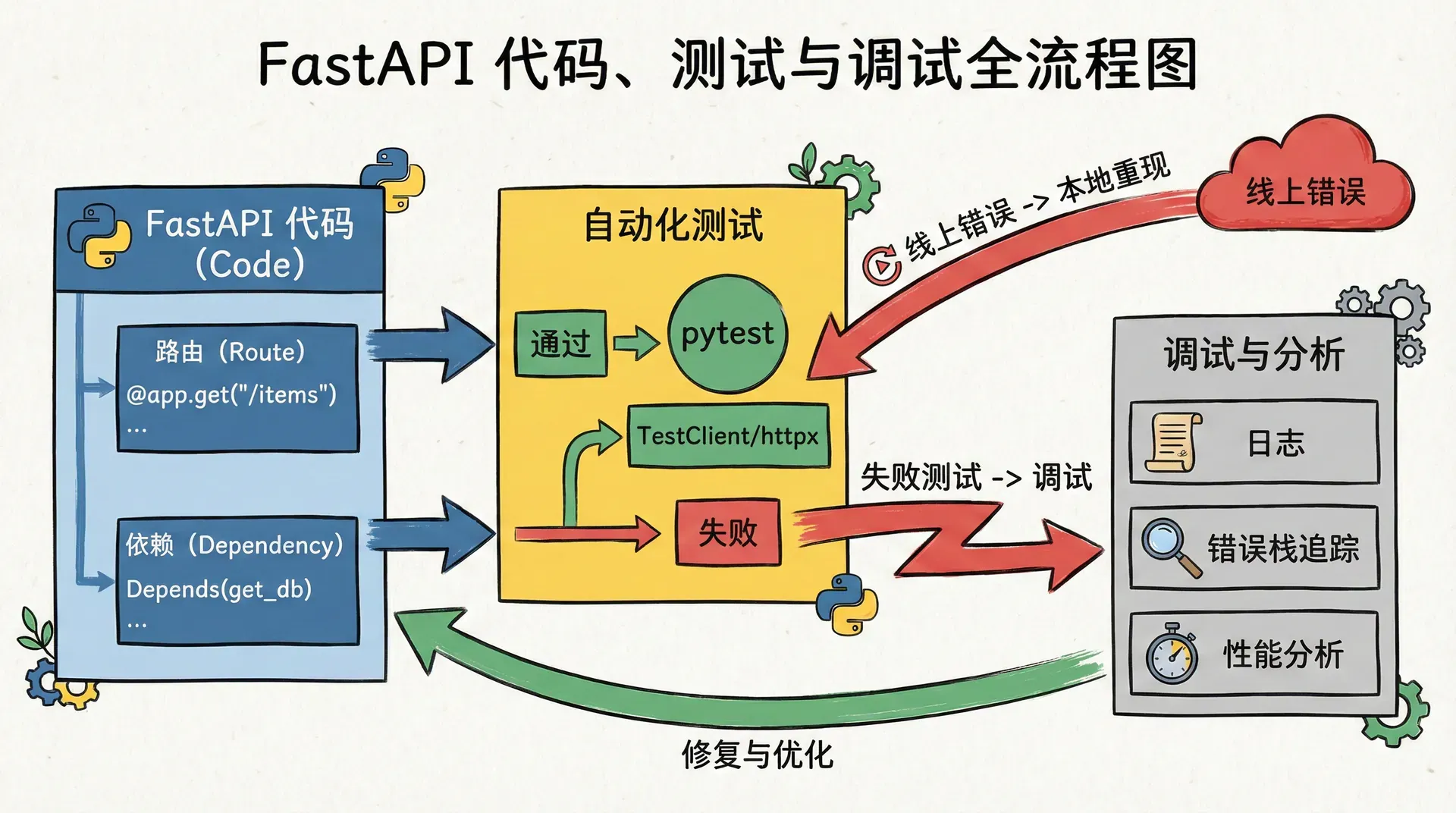

当我们刚开始写FastAPI接口时,最常见的验证方式就是“启动服务、打开浏览器、手点几下、看一眼返回值”。这种方式在刚起步的时候很方便,也很有成就感,但是一旦接口数量多起来、逻辑变复杂,靠手动点击去保证正确性就会变得既低效又脆弱。 真正能陪着一个后端项目长期演进的,是一套可靠的自动化测试,以及一整套调试与观测手段,让我们在出现问题时能够快速定位原因,而不是在黑箱里盲人摸象。

这一节课,我们会一起把“测试与调试”这件事拆成几个层次来构建。我们会先从最基础的单元测试和集成测试开始,使用pytest和FastAPI自带的TestClient,把路由和依赖当作普通函数一样测试;然后我们会把注意力放到异步路由和异步数据库调用上,看到如何用httpx和pytest-asyncio来写端到端测试。 接着,我们会讨论如何在测试中覆盖依赖,模拟认证用户和外部服务,避免为了跑测试去真的发起HTTP请求或者连真实数据库。最后,我们会从调试和观测的角度出发,讲清楚日志、错误栈、交互式调试器、性能分析和本地环境变量这些工具如何协同工作,让我们的FastAPI应用在出问题时有足够的“自述能力”。

从最小可行的单元测试开始

在很多团队里,“测试”这件事常常被误解成“必须上来就写一大堆复杂的集成测试”。这种做法的结果往往是:测试维护成本过高,于是大家慢慢就不再愿意写任何测试。我们更倾向于一种循序渐进的方式,从最小可行的单元测试开始,把那些纯函数、简单服务类和不依赖外部资源的逻辑先覆盖起来,再逐渐往外扩展到依赖数据库、依赖网络、依赖外部服务的部分。

在FastAPI项目中,路由函数本身往往会依赖很多外部资源,因此它们更适合通过TestClient或httpx在集成层测试。但我们在前面几章中已经把大部分复杂逻辑封装进了独立的函数和类,比如密码校验、token生成、权限判断、模型转换和存储服务。这些函数完全可以用最经典的pytest单元测试方式来验证,不需要起服务、不需要网络,也不需要数据库。

# app/security.py

from datetime import timedelta

from jose import jwt

SECRET_KEY = "change_me"

ALGORITHM = "HS256"

def create_access_token(data: dict, expires_delta: timedelta) -> str:

to_encode = data.copy()

to_encode["exp"] = ...

encoded_jwt = jwt.encode(to_encode, SECRET_KEY, algorithm=ALGORITHM)

return encoded_jwt# tests/test_security_unit.py

from datetime import timedelta

from jose import jwt, JWTError

from app.security import create_access_token, SECRET_KEY, ALGORITHM

def test_create_access_token_can_be_decoded():

payload = {"sub": "alice"}

token = create_access_token(payload, timedelta(minutes=5))

decoded = jwt.decode(token, SECRET_KEY,

这样的测试非常朴素,却立刻给了我们一个重要的保证:只要这条测试在CI上一直是绿色的,我们就可以放心在别的地方调用create_access_token,而不用担心因为某次重构把exp放错地方或者把算法名写错。更重要的是,这种测试执行速度极快,往往在几毫秒之内就能完成,我们完全可以在本地开发时频繁跑它们,用它们作为修改代码的“护栏”。

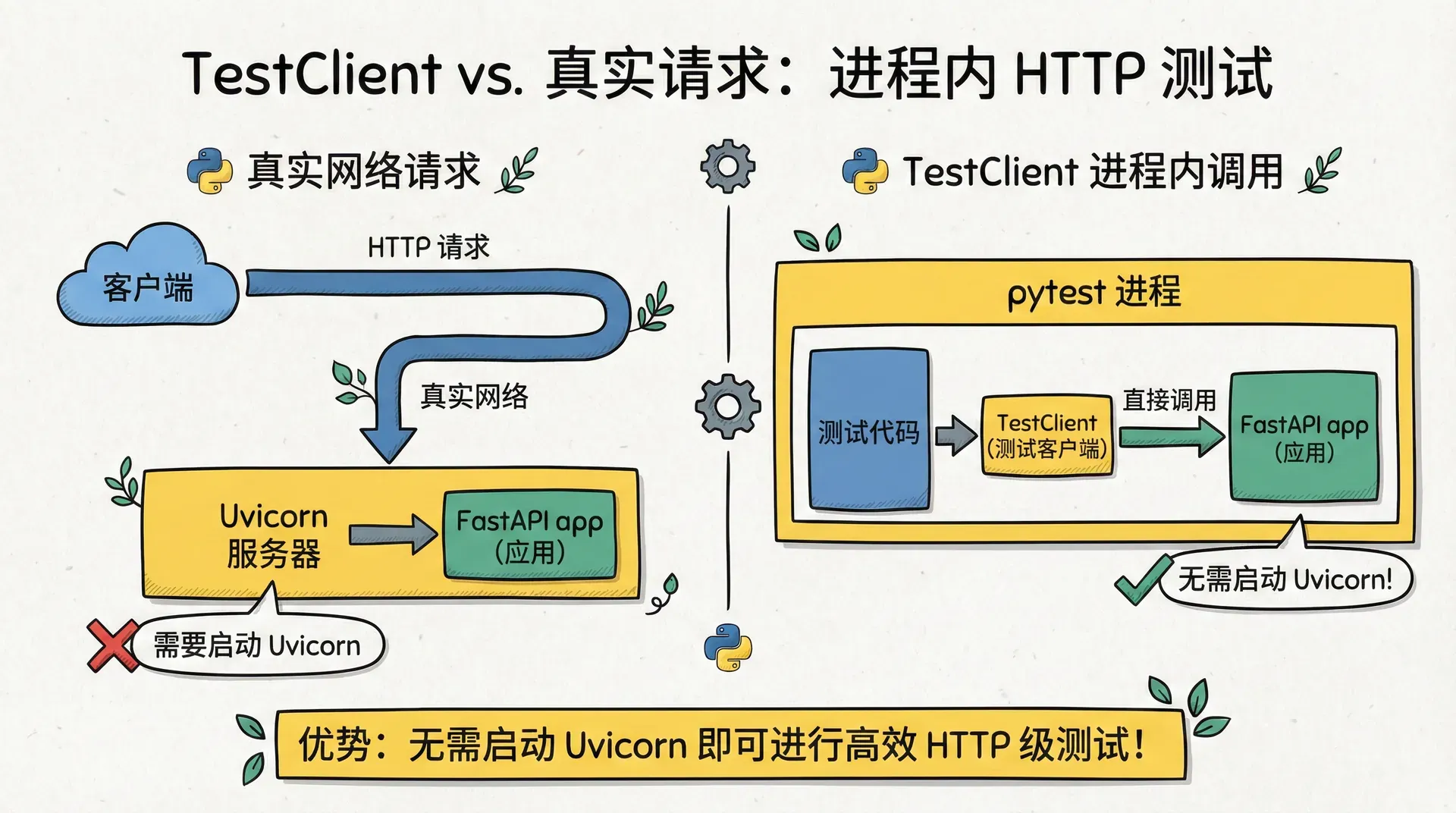

使用 TestClient 写出第一个端到端接口测试

单元测试只能证明“局部逻辑是对的”,它并不能保证整个请求从HTTP层进来之后,经过依赖解析、模型验证、路由分发、业务处理和响应序列化这一整条链路都按预期工作。为了覆盖这条完整路径,我们需要写端到端的接口测试。FastAPI为我们提供了一个非常好用的工具:TestClient,它基于requests风格的API,让我们可以在不真正启动Uvicorn的情况下,对应用发起HTTP级别的请求。

# app/main.py

from fastapi import FastAPI

app = FastAPI()

@app.get("/ping")

def ping():

return {"message": "pong"}# tests/test_ping.py

from fastapi.testclient import TestClient

from app.main import app

client = TestClient(app)

def test_ping_returns_pong():

response = client.get("/ping")

assert response.status_code == 200

assert response.json() == {"message": "pong"}这个测试虽然简单,却走完了整个FastAPI请求处理流程。我们在这里看到的模式是:把FastAPI应用实例当作一个普通对象引入测试模块,然后用TestClient在同一个进程里模拟HTTP请求。这种方式在本地非常高效,也方便我们在测试中覆盖依赖。

异步路由与 httpx:在事件循环里做真正的集成测试

随着我们引入异步数据库访问和异步外部HTTP调用,越来越多的路由函数会以async def形式存在。TestClient在很多场景下仍然可用,但如果我们希望用真正的异步客户端去测试异步路由,或者希望更精细地控制事件循环,就需要引入httpx和pytest-asyncio。

# app/main.py 片段

from fastapi import FastAPI

app = FastAPI()

@app.get("/async-hello")

async def async_hello():

return {"message": "hello from async"}# tests/test_async_routes.py

import pytest

from httpx import AsyncClient

from app.main import app

@pytest.mark.asyncio

async def test_async_hello():

async with AsyncClient(app=app, base_url="http://test") as ac:

resp = await ac.get("/async-hello")

assert resp.status_code == 200

这里我们通过AsyncClient(app=app, base_url="http://test")直接把FastAPI应用挂在httpx上,这样所有请求都在同一事件循环中完成,不需要真实网络,也不需要起额外进程。这种测试方式对于异步数据库操作特别友好,我们可以在一个async测试函数里既等待HTTP调用,又等待AsyncSession操作,从而覆盖真正的I/O路径。

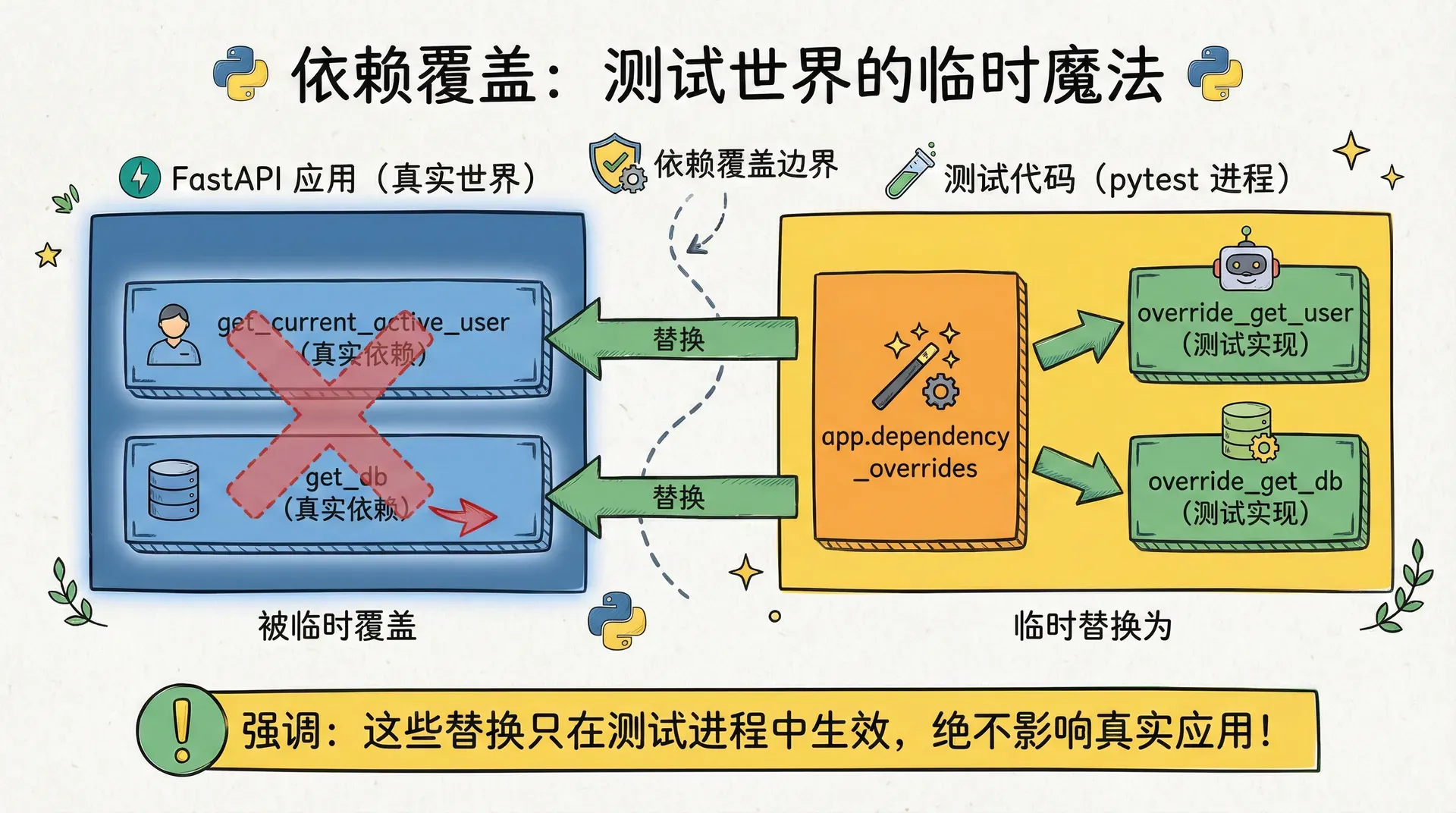

依赖覆盖:在测试里“换掉”认证、数据库和外部服务

FastAPI的依赖注入机制在测试时展现出了极大的威力。我们已经在前几章里把认证、授权、数据库会话和存储服务都写成了依赖函数或类,现在我们可以在测试里通过app.dependency_overrides把它们换成更轻量、更可控的实现,从而在不访问真实资源的前提下,测试业务逻辑是否正确。

例如,在测试受保护的端点时,我们不想真的去算JWT,也不想依赖真实的用户表。我们完全可以在测试里定义一个假的get_current_active_user,让它总是返回一个预期用户,然后覆盖原来的依赖。

from fastapi.testclient import TestClient

from app.main import app

from app.auth import get_current_active_user, User

client = TestClient(app)

def override_get_current_active_user():

return User(username="test-user", email="test@example.com", disabled=False, role="admin")

app.dependency_overrides[get_current_active_user]

同样地,我们可以为数据库Session提供一个内存SQLite实例,或者为存储服务提供一个只在本地某个临时目录写文件的实现。这种覆盖让测试既能走完整的业务逻辑,又不至于每次都去操作真正的生产资源。

用断言和工厂模式管理测试数据

写测试时一个经常被忽视的细节,是“测试数据从哪里来”以及“测试之间如何隔离”。如果我们在每个测试里都手写一堆魔法值,然后在断言里也硬编码这些值,测试会很快变得难以维护。一旦模型结构或业务规则发生变化,修改测试就变成一件非常痛苦的事。

在FastAPI项目中,我们可以借助Pydantic模型本身来构造测试数据,或者引入简单的工厂函数来统一创建对象。这样一来,当模型字段变化时,我们只需要修改工厂而不是到处搜字符串。

from app.schemas import CourseCreate

def make_course_payload(**overrides):

data = {

"title": "FastAPI 入门",

"description": "我们一起从零开始搭一套API",

"level": "beginner",

}

data.update(overrides)

return CourseCreate(**data)在测试中,我们可以使用这个工厂创建合法的、或刻意带有边界值的payload,然后通过TestClient发请求。断言时也尽量使用模型的字段访问,而不是直接比对整个JSON,这样测试对字段新增和默认值的变化会更加宽容。

日志与错误栈:让应用在出问题时“会说话”

再完善的测试也无法预防所有错误,尤其是在真实流量、复杂数据和外部系统参与的情况下。当错误发生时,日志和错误栈就是我们最重要的调查线索。FastAPI本身使用的是标准的logging体系,而Uvicorn则在启动时配置了基础的日志输出。我们可以通过在应用中合理使用logger,以及在配置中调整日志级别和格式,来让日志既不过于噪杂,又能在需要时提供足够细节。

import logging

logger = logging.getLogger("app.api")

@app.get("/courses/{course_id}")

async def get_course_detail(course_id: int, db: Session = Depends(get_db)):

logger.info("收到课程详情请求 course_id=%s", course_id)

course = db.query(Course).filter(Course.id == course_id).first()

if not course:

logger.warning("课程未找到 course_id=%s"

当我们在本地调试时,可以把日志级别调到DEBUG,观察SQLAlchemy输出的SQL、依赖解析过程以及中间变量;在生产环境中,则可以使用INFO或WARN级别,配合结构化日志和集中式日志系统(如ELK或云厂商的日志服务)进行分析。关键在于,我们要养成在关键路径上留下有用日志的习惯,而不是等到问题发生才临时去print。

对于捕获不到的异常,FastAPI和Uvicorn会自动生成错误栈并返回500响应。我们可以通过自定义异常处理器,在保证不向客户端泄露敏感细节的前提下,把完整的错误信息记录到日志中。这在调查偶发错误时尤为重要。

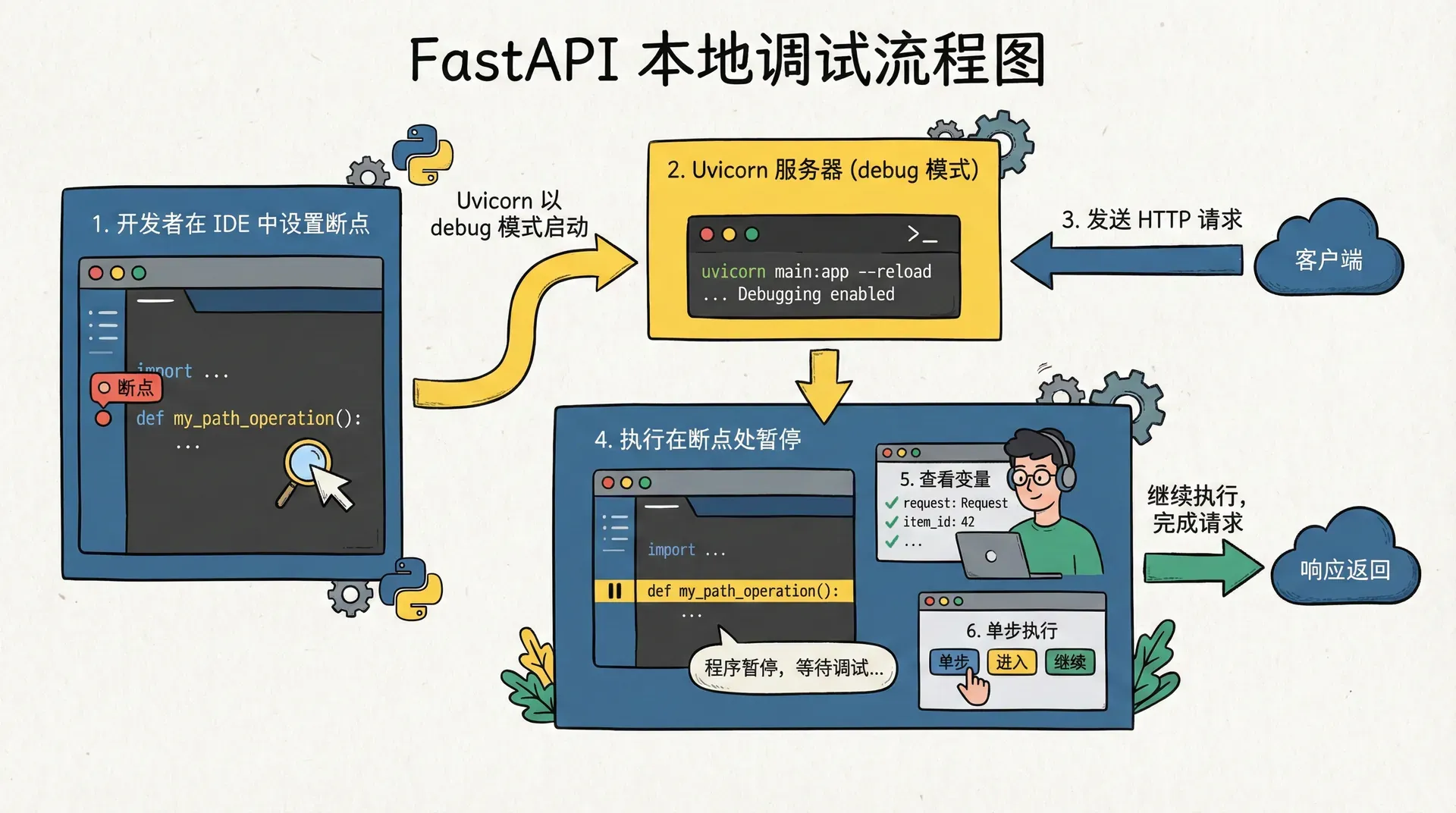

交互式调试与本地重现

有了测试和日志,我们往往已经可以很快定位大部分问题,但在某些棘手场景下,我们仍然需要停下程序,在某个断点上“看看当时究竟发生了什么”。Python提供了内置的pdb调试器,现代IDE也提供了更友好的图形化调试界面。FastAPI作为一个普通的Python程序,可以很好地配合这些工具工作。

一种常见的做法是在本地以reload方式启动Uvicorn,同时在IDE里配置一个“附加到运行中的Python进程”的调试配置,然后在目标路由函数或依赖函数中下断点。当请求到达时,执行会在断点处暂停,我们可以检查所有局部变量、调用栈以及Session里的对象状态。这种方式比单纯看日志更直观,也更适合分析复杂业务逻辑。

另一方面,当我们在生产环境中遇到某个特定请求导致的异常或性能问题时,最有效的做法往往是“本地重现”。这需要我们在日志中记录足够的信息,比如请求路径、查询参数、关键头部和部分请求体摘要,然后在本地构造同样的请求,通过测试或手动调用来触发同样的路径。只要能够稳定重现,调试就从“猜测式排查”变成“实验式验证”,效率会有数量级提升。

性能与压力测试:在瓶颈出现之前看见它

虽然这一部分的重点是正确性与可调试性,但对于后端来说,我们也应该在合适的时机引入“性能与压力测试”的概念。FastAPI本身以高性能著称,但一旦我们接入数据库、外部服务和复杂业务逻辑,瓶颈往往就不在框架本身,而在我们如何使用这些资源。

在实践中,一种有效的做法是先用简单的基准测试工具(比如wrk、hey或ab)对关键端点进行压测,观察在不同并发度下的吞吐量和延迟分布,再结合应用内部的日志和性能分析(比如SQLAlchemy的查询日志、数据库慢查询日志、以及Python层的profiling)来判断问题所在。我们不需要在课程阶段就实现一整套完善的APM系统,但我们可以先种下一个习惯:当应用感觉“有点慢”时,不要凭感觉猜测原因,而是先用工具画出一个大致的性能轮廓。

在本地环境中,我们可以先让数据库和应用跑在同一台机器上,用uvicorn app.main:app --reload启动服务,然后用压测工具对一个典型的端点发起一小段时间的压力请求。观察CPU占用、响应时间分布和错误率,再结合日志和指标,就能大致判断是CPU被某个算法拖住了,还是数据库查询写得不够好,亦或是连接池配置不合理。

小结

这部分里,我们没有再叠加新功能,而是专注聊聊:怎么确认代码是靠谱的,出现问题又该如何快速定位。我们先用简单明了的pytest单元测试给核心逻辑(比如密码校验、token生成)加好“安全气囊”,再用TestClient、httpx等工具从接口层把路由、依赖、模型校验整个流程串起来做自动化测试。

在此基础上,我们学会了用依赖注入把认证、数据库、外部服务都“换成可控的假对象”,让测试更安全、更可预测。同时也没有忘记日志和错误栈的重要性——不靠猜,靠有用的日志精准定位问题。 遇到棘手bug,还可以借助断点调试和本地复现把“偶发现象”变成“可重现的实验”。最后也简单体验了下性能和压力测试——只有通过测试和监控,才能让服务既正确又跑得稳。

接下来当我们进入部署和实战环节时,这套测试和调试“底气”将会一直陪伴我们。每次大改动,都能先跑一圈测试、查查日志,确认一切OK再上线!